La présence de résidus de pesticides dans de nombreux aliments fait régulièrement polémique, certains les accusant d'être cancérigènes, d'autres refusant de condamner ces produits sans preuve au profit de ceux issus de l'agriculture biologique. Qui a tort, qui a raison ? Difficile à dire, du moins... jusqu'à aujourd'hui !

Une étude menée par des chercheurs français et parue au mois d'octobre 2018 dans la revue médicale The Jama Internal Medicine semble en effet confirmer les vertus d'une alimentation faisant la part belle aux aliments bio. Menée auprès de 70 000 personnes de 2009 à 2016, l'étude avait pour objectif de mettre en évidence ou non le lien entre type d'alimentation et déclaration d'un cancer.

Et les résultats sont sans appel ! Après sept années d'études, les chercheurs ont constaté que le risque de développer un cancer était réduit de 25% chez les plus gros consommateurs de produits bio. Chez les femmes ménopausées, le risque de déclarer un cancer du sein est diminué de 34%. Mieux encore, le risque de lymphomes est quant à lui diminué de 76%.

Si ces chiffres ont de quoi ravir ceux qui se sont déjà convertis au bio, ils restent cependant à prendre avec des pincettes. Il se pourrait en effet que les consommateurs de produits issus de l'agriculture biologique aient une meilleure hygiène de vie, ce qui pourrait avoir un impact direct sur leur santé. Les adeptes du bio peuvent aussi appartenir à la famille des non-fumeurs, pratiquer une activité sportive régulière, avoir une consommation d'alcool limitée, ou encore posséder des revenus plus élevés leur permettant notamment de mieux se soigner.

Mais si le lien entre présence de résidus de pesticides dans l'alimentation et cancers venait à se confirmer, une autre question que celui du mode de culture devrait se poser, celle de l'inégalité d'accès aux produits bio du fait de leur coût plus élevé. Plus qu'une question de santé, c'est aussi une question de société à laquelle nous risquons d'être confrontés.

Manger bio réduirait les risques de cancer

Temps de lecture : 2 min

Vivre près d'un espace vert permettrait d'avoir un âge biologique plus jeune

Vivre près d'un espace vert permettrait d'avoir un âge biologique plus jeune Remède naturel : prudence avec le vinaigre de cidre !

Remède naturel : prudence avec le vinaigre de cidre ! Voici les 5 activités physiques les plus bénéfiques pour la santé

Voici les 5 activités physiques les plus bénéfiques pour la santé La nouvelle gamme de meubles IKEA n'oublie pas les gamers

La nouvelle gamme de meubles IKEA n'oublie pas les gamers Orange pêche, gris poivré ou vert kaki, quelle est la couleur de l'année 2024 ?

Orange pêche, gris poivré ou vert kaki, quelle est la couleur de l'année 2024 ? Grâce à cette couleur, le prix de vente de votre logement pourrait augmenter

Grâce à cette couleur, le prix de vente de votre logement pourrait augmenter Une fresque murale qui s'adapte à votre déco

Une fresque murale qui s'adapte à votre déco Confiez vos repas à un professionnel

Confiez vos repas à un professionnel Home staging : mettez votre maison en valeur

Home staging : mettez votre maison en valeur Illuminez votre jardin

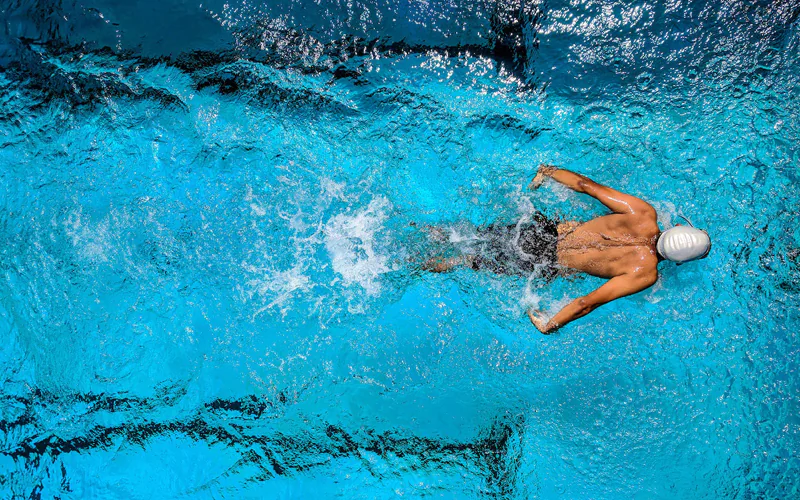

Illuminez votre jardin Les piscines

Les piscines Des chambres d'hôtel sorties d'un rêve

Des chambres d'hôtel sorties d'un rêve Pour vous laver, vous préférez la douche ou le bain ?

Pour vous laver, vous préférez la douche ou le bain ? Vivre seul, c'est un choix ou un poids ?

Vivre seul, c'est un choix ou un poids ? Sauna ou hammam : rêvez-vous d'un bain de vapeur à domicile ?

Sauna ou hammam : rêvez-vous d'un bain de vapeur à domicile ? Savez-vous effectuer des petits travaux de plomberie ?

Savez-vous effectuer des petits travaux de plomberie ? Faites-vous attention à l'alimentation des enfants ?

Faites-vous attention à l'alimentation des enfants ? Connaissez-vous bien le feng-shui ?

Connaissez-vous bien le feng-shui ? Cache-pot Sverre

Cache-pot Sverre  Lampe lapin Apolline

Lampe lapin Apolline  Lampe Vase

Lampe Vase  Tête de lit Morphée

Tête de lit Morphée  Statue Panthère Noire Sumatra

Statue Panthère Noire Sumatra